Technologický lídr Nvidia začíná přesouvat své strategické těžiště od infrastruktury pro trénování modelů k jejich praktickému nasazení. Pro investory tento krok představuje zásadní posun v tom, odkud může přijít další vlna růstu.

Zatímco úvodní keynote Jensena Huanga na konferenci GTC v minulosti působila jako prezentace produktové roadmapy, letos připomínala spíše vyhlášení nové éry AI infrastruktury. Nvidia, která dlouhodobě dominovala dodávkám výpočetní infrastruktury pro trénování velkých jazykových modelů pro firmy jako OpenAI, Microsoft nebo Meta, nyní otevřeně akcentuje novou prioritu: inference a autonomní AI agenti.

Pro retailové investory nejde o pouhou technickou nuanci. Jde o signál, že se ekonomika umělé inteligence postupně přesouvá z fáze experimentů do fáze masového provozu, kde vznikají stabilnější a lépe škálovatelné zdroje příjmů.

Zásadní otázka pro trh však zní: dokáže Nvidia dominovat i v této etapě?

Přelom na GTC: inference jako nové centrum AI ekonomiky

Když Jensen Huang vystoupil na pódiu GTC 2026, nezaměřil se na jediný produkt, ale na změnu celého narativu. Předestřel svět, v němž AI nebude pouze trénována, ale bude nepřetržitě pracovat jako digitální infrastruktura podporující autonomní softwarové agenty.

Klíčovým pojmem je zde inference - fáze, kdy se hotový model používá v praxi. Každý dotaz do chatbota, personalizované doporučení v e-shopu nebo rozhodnutí průmyslového robota představuje inferenční operaci. Některé analytické odhady naznačují, že již v roce 2026 mohou tyto workloady tvořit většinu poptávky po AI výpočtech. To představuje výrazný odklon od předchozích let dominovaných trénováním modelů a pro investory to znamená posun od jednorázových kapitálových výdajů k dlouhodobému provozu infrastruktury.

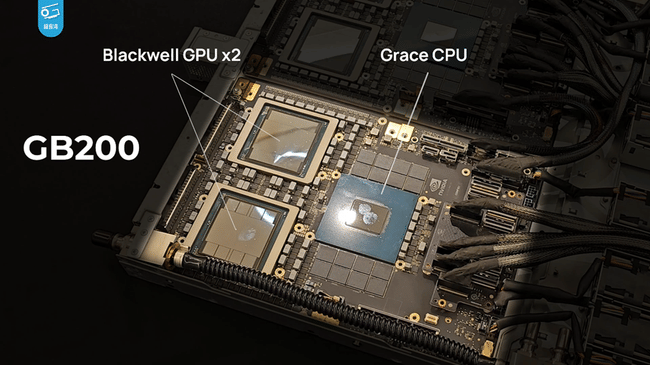

Nvidia na tento trend reaguje již na úrovni architektury. Platforma Blackwell byla navržena jako univerzální generace akcelerátorů pro trénování i inferenci velkých modelů a podle některých benchmarků může v určitých inferenčních scénářích dosahovat až několikanásobně vyššího výkonu oproti předchozí generaci Hopper.

AI agenti: digitální pracovní síla vyžaduje novou infrastrukturu

Zatímco inference představuje technologický základ, autonomní agenti jsou především ekonomickým příběhem. $NVDA popisuje budoucnost, ve které AI nebude pouze odpovídat na dotazy, ale bude samostatně plánovat, analyzovat a vykonávat komplexní úkoly napříč softwarovými systémy.

Tato tzv. agentická AI má jedno důležité specifikum: pravděpodobně generuje výrazně vyšší objem inferenčních operací než klasické chatboty. Každý krok v rozhodovacím procesu agenta vyžaduje další výpočetní operace a spotřebu GPU výkonu.

Tento posun vytváří nový typ poptávky:

• kontinuální inference namísto nárazového trénování

• vyšší objemy tokenů na jednoho uživatele

• nízká latence jako kritický požadavek pro reálné nasazení

• datová centra optimalizovaná pro vysokou inferenční propustnost a práci s dlouhým kontextovým oknem modelů

Právě proto Nvidia představila nové generace datacentrových akcelerátorů, networkingových řešení a DPU architektur, jako je BlueField-4, které pomáhají odstraňovat úzká hrdla při provozu rozsáhlých AI workloadů. Firma tak již nestaví pouze jednotlivé čipy, ale buduje kompletní infrastrukturu pro provoz AI aplikací v datových centrech.

Stabilita a cash flow: proč je inference pro investory atraktivní

Ačkoliv je trénování modelů mediálně výraznější, inference může být z ekonomického hlediska stabilnější. Model se typicky trénuje méně často, než kolikrát je následně používán v produkčním provozu, přičemž každý uživatel a každá aplikace generují kontinuální výpočetní zátěž.

Podle prezentací Nvidie může infrastruktura Blackwell v určitých scénářích inferenčního nasazení přinášet výrazně vyšší výnosnost infrastruktury měřenou objemem zpracovaných tokenů oproti předchozím generacím.

Z pohledu akcionářů má tento model několik strategických výhod:

dlouhodobější cash flow díky posunu od jednorázových projektů k provozní infrastruktuře

opakující se poptávka vyvolaná růstem objemu AI provozu

diverzifikace zákaznické základny směrem k enterprise segmentu a regionálním cloudovým poskytovatelům mimo hlavní hyperscalery

Rizika a výhled pro akcie

Změna strategie je pro Nvidii krokem útočným i obranným zároveň. Velcí hráči jako Google nebo Amazon vyvíjejí vlastní AI čipy, mimo jiné právě pro inferenci, kde je tlak na cenu nejvyšší.

Nvidia proto reaguje silnější vertikální integrací. Nabízí kompletní technologický stack zahrnující akcelerátory, networking, DPU architektury i software, aby zůstala pro provoz datových center strategickým partnerem. Cílem je vytvořit prostředí, kde jednotlivé vrstvy infrastruktury fungují v těsné synergii, což konkurenci ztěžuje nabídnout plnohodnotnou alternativu.

Dominance firmy sice není absolutní, což naznačují například snahy OpenAI testovat alternativní hardware, analytici se však shodují, že právě agentická AI může vytvořit další růstovou vlnu srovnatelnou s nástupem generativní AI v letech 2023-2024.

Infrastruktura pro digitální zítřek

Nvidia se během posledních dvou let transformovala z dodavatele akcelerátorů pro výzkumné laboratoře v jednoho z klíčových architektů globální AI infrastruktury.

Inference není pouze další technickou fází vývoje modelů. Představuje okamžik, kdy se umělá inteligence začíná ve velkém měřítku integrovat do produkčních systémů firem i veřejných služeb. Pokud se autonomní agenti stanou běžnou součástí podnikových procesů, může poptávka po výpočetním výkonu růst rychleji, než dnes trh očekává.

Budoucnost Nvidie se tak nebude rozhodovat pouze při trénování modelů, ale především v datových centrech, kde tyto modely každodenně běží v produkčním provozu.